讲座思考 | 周志华教授:新型机器学习神经元模型的探索

12月22日,有幸听了南京大学周志华教授题为“新型机器学习神经元模型的探索”的讲座。现场热闹非凡,大家像追星一样拿着“西瓜书”找周教授签名。周教授讲得依旧循循善诱,由浅入深,听得我很入迷,故作此记。

周教授首先就人工智能领域火热发展的原因提出了自己的见解,强调了人工智能中基础算法相较于算力的基础性作用:算力提升论或为误解,应当是算法带来基础性突破,然后算力的提升才能在其后一段时间内放大算法突破带来的红利。 周教授随后举例说明,BP算法在深层神经网络里存在着梯度消失问题,而2006年随着Hinton的深层模型问世,深度学习一直在近二十年的时间内火热不已,并随着算力不断提升在不同领域有着越来越亮眼的表现。

接着周教授乘势抛出了两个贯穿本次演讲始终的公式:“神经网络=神经网络模型+学习算法”,而神经网络模型=神经元模型+网络结构。周教授解释道,学习算法指的就是BP算法这种历久弥新的算法,而本次演讲的重点——神经元模型,指的就是受生物神经元接受多个电信号输入,达到阈值后激活并输出的启发,所设计的机器学习神经元数学模型,即著名的M-P神经元模型,形如:

$$ y = f(\sum_{i=1}^n w_i x_i - \theta) $$

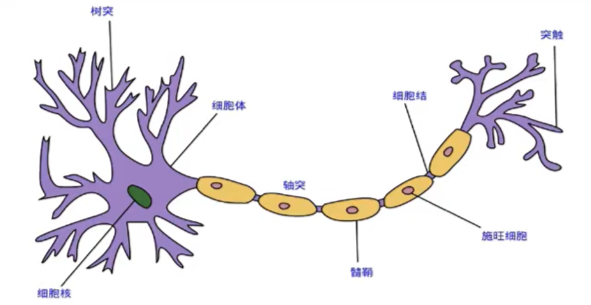

生物神经元

生物神经元周教授指出,关于神经网络的大多数研究都注重在网络结构上做设计,而关于神经元模型的研究甚少,甚至问世近80年的M-P神经元模型到今天仍然遍地在用。此外,近来关于神经元模型的研究又开始有所浮现,讨论能否有别的神经元模型可以使用。在这样的背景下,周教授团队着手了新型神经元模型的相关研究。

周教授首先分享了他们团队在分岔脉冲神经网络 (Bifurcation Spiking Neural Network) 方面的研究1。

首先,脉冲神经网络中一种被广泛研究的神经元模型叫做Leaky integrate and fire (LIF) 模型,LIF神经元模型除了考虑信号的传递和神经元激活,还考虑了信号传递的时间累计过程,其一般形式为:

$$\tau \frac{du}{dt} = -u + R f(\bold{I(t)})$$

周教授团队从动力系统视角进行分析,发现基于LIF神经元模型的脉冲神经网络的解空间是分开的三部分,由参数$\tau$决定。因此提出了分岔脉冲神经网络(Bifurcation Spiking Neural Network, BSNN),实现了自适应动力系统,将解空间连起来,解决了解空间分岔的问题,使得解空间可达。

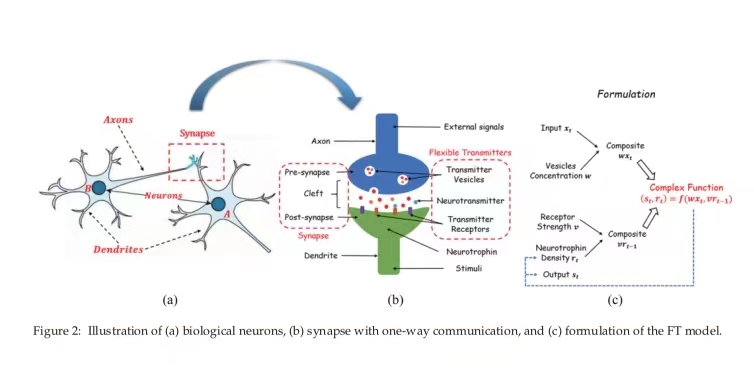

周教授进一步分享了他们团队提出的一种生物上合理且具有灵活的突触可塑性的全新神经元模型:Flexible Transmitter (FT) Model 2.

这种FT神经元模型参考了生物神经元的神经递质传递过程,尤其是突触的收缩和发育过程,神经递质不仅起到信号传递作用,还会控制突触发育和收缩,使得神经递质的接受量相应增大和缩小,这一过程如下图所示。

生物神经元中突触的神经递质传递与突触伸缩过程

生物神经元中突触的神经递质传递与突触伸缩过程FT神经元模型可以表示为:

$$(s_t,r_t) = f(wx_t,vr_{t-1})$$

用复数进行数学上的抽象可表示为:

$$s_t +r_t \bold{i} = f(wx_t,vr_{t-1} \bold{i} )$$

周教授强调,这种FT神经元模型的能力更加强大,因为M-P神经元模型只是FT神经元模型的一个子集。

一种简单基于FT神经元模型的FT神经网络 (FTNet) 同样也被展示:

$$ \bold{s_t} +\bold{r_t i} = f( \bold{Wx}_t, \bold{Vr}_{t-1} \bold{i} )$$

周教授认为,这种新型FT神经元模型和基于其上的FT神经网络具有更加强大的能力,可以解决以前基于M-P神经元的神经网络无法解决的问题。周教授团队在一些简单的任务上和常见的神经网络进行对比,例如在MNIST数据集上,和CNN、RNN、基于M-P神经元的FCN、基于脉冲神经网络的SNN等,结果显示基于FT神经元的神经网络具有最高的Accuracy。但这并非没有代价,周教授毫不掩饰地指出了FT神经网络存在的问题,即更多的计算时间。

演讲结束后,老师同学们都很感兴趣,不断提出自己的疑惑并向周教授请教。而周教授也非常耐心、坦诚地回答,整个问答环节持续了超过半小时。